إزرا كلاين*

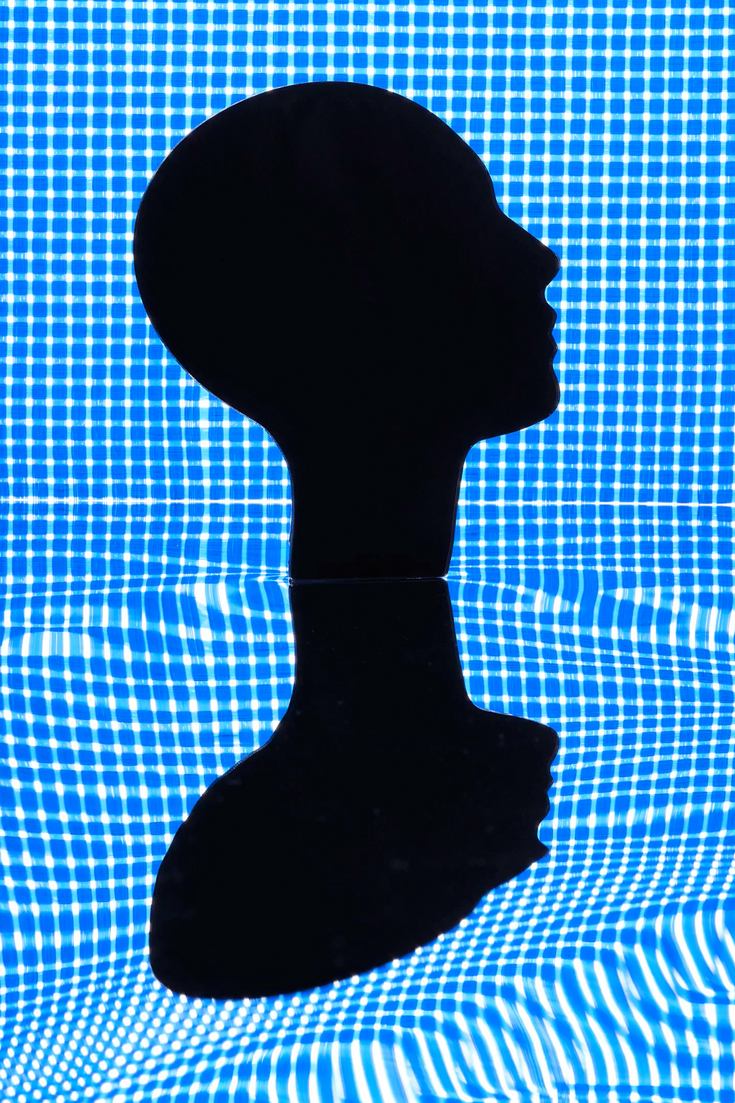

في كتابه الكلاسيكي «فهم وسائل الإعلام»، يتوقف مارشال ماكلوهان مطولاً عند الأسطورة اليونانية لنرجس، وإذا مرّ وقت منذ قراءتها، فالقصة، وفقاً لرواية الشاعر الروماني أوفيد، تبدأ بولادة نرجس، الشاب الخارق الجمال، الذي لُعن بأن يحب ما لا يستطيع امتلاكه، حتى وجد هذا الحب عند اصطدامه بانعكاس صورته في بركة ماء، فظل يحدق في عينيه اللامعتين حتى ذبل واضمحل.

يقول ماكلوهان إن ذلك يعكس ثقافتنا “المخدّرة”، وأننا بدأنا نتحدث عن النرجسية على أنها حب الذات، لكنه يوضح أن الأسطورة تكشف عن شيء أعمق: «أسطورة نرجس لا تنقل أي فكرة عن أن نرجس وقع في حب ما اعتبره ذاته»، بل المغزى الحقيقي هو أن “الإنسان يُفتن فوراً بأي امتداد لذاته في مادة ليست هي ذاته”.

أفكر في ماكلوهان بقدر ما يُقال إن الناس يفكرون في الإمبراطورية الرومانية: كثيراً. وهو حاضر في ذهني الآن لأنني أستكشف العلاقة المتعمقة التي يطورها كثير من الناس مع أنظمة الذكاء الاصطناعي الخاصة بهم. هذه الأنظمة، بطبيعتها المتغيرة، ليست شيئاً واحداً فقط؛ لكنها، ضمن أمور كثيرة، تجسّد ما حذّر منه ماكلوهان: امتداد للذات في مادة ليست هي الذات.

قضيت الأسبوع الماضي في سان فرانسيسكو أتحدث إلى أشخاص على حدود عصر الذكاء الاصطناعي، أحاول القيام بذلك كل بضعة أشهر، لكن محادثاتي هذه المرة شعرت مختلفة عن المرات السابقة، في السابق، كنت أرى كيف تتغير التكنولوجيا؛ هذه المرة، رأيت كيف يتغير الناس بها.

قد تظن أن خبراء الذكاء الاصطناعي في وادي السيليكون، وسط وفرة المال، على قمة العالم الآن، لكنني وجدتهم غير آمنين بشكل لافت، يعتقدون أن عصر الذكاء الاصطناعي قد وصل، وأن الفائزين والخاسرين سيتحددون جزئياً بسرعة التبني.

الفكرة بسيطة: مزايا العمل مع جيش من المساعدين والمبرمجين المعتمدين على الذكاء الاصطناعي تتراكم مع الوقت، ومن يبدأ مبكراً سيكون متقدماً على منافسيه لاحقاً، لذلك يتسابقون لدمج هذه الأنظمة في حياتهم وشركاتهم، لكن الأمر لا يقتصر على استخدامها فحسب، بل يتطلب جعل أنفسهم «مفهومين» للذكاء الاصطناعي.

ربما سمعت عن نظام “أوبن كلو”، الذي أصبح ظاهرة هنا وفي الصين. ما يميّزه عن أنظمة مثل “كلود” أو “شات جي بي تي” أو “جيميني” أنه يعمل محلياً على جهازك، حيث يمكنك منحه الوصول إلى كل شيء: ملفاتك، بريدك الإلكتروني، تقويمك، رسائلك، وهو يعمل في الخلفية باستمرار، ويبني ذاكرة دائمة عن تفضيلاتك وأنماطك ليتمكن من التصرف نيابة عنك. صحيح أن مخاطر الأمن السيبراني واضحة، لكن السبب وراء استخدام ملايين الناس له بسيط: كلما فتحت له حياتك أكثر، زادت قيمته.

الشركات تسعى أيضاً لتكون مفهومة للذكاء الاصطناعي، رأيت مؤسسات وضعت كل شيفراتها البرمجية في قاعدة بيانات واحدة ليقرأها الذكاء الاصطناعي بسهولة، بل ويضيف إليها، وتحدثت إلى أشخاص يسعون لتحويل أكبر قدر ممكن من اتصالات شركاتهم إلى مستندات يمكن للذكاء الاصطناعي قراءتها. محادثة عابرة في الممر لا تضيف شيئاً، في حين أن محادثة على تطبيق سلاك في قناة عامة قد تضيف كثيراً. وهناك سوق ناشئ للأجهزة الذكية القابلة للارتداء تسجل هذه المحادثات لتضمن أن الذكاء الاصطناعي لا يفوت شيئاً.

أخبرني أشخاص عدة أنهم أصبحوا «يكتبون من أجل الذكاء الاصطناعي». حتى عندما يبدو أن كتابتهم موجهة لزملائهم أو قرّائهم، فهم يفكرون في كيفية قراءة هذه الكلمات من قبل الأنظمة. أحياناً لتعميق معرفة أنظمة شركاتهم، وأحياناً لتغذية الأنظمة المستقبلية التي ستصبح مستودعات المعرفة البشرية.

ويطبق هذا على الجانب الشخصي أيضاً: أعرف أشخاصاً يحتفظون بمذكرات لسنوات، والآن يرفعونها إلى أي نظام ذكاء اصطناعي جديد يستخدمونه. تحولت المذكرات من مساحة خاصة للتفريغ النفسي إلى حزمة سياقية تساعد الأنظمة على فهمهم، وبالتالي زيادة فائدتها لهم. لكن هذا يغير بالطبع طريقة الكتابة نفسها: ما كان خاصاً أصبح له قارئ.

خلف هذا التوجه تجربة للذكاء الاصطناعي لم يمر بها معظم المستخدمين العاديين. نظام لا يعرفك جيداً قد يكون مجرد تحسين على البحث عبر محرك جوجل. لكن نظاماً يعرفك بعمق يبدو شيئاً مختلفاً تماماً. وصف البعض أنظمة الذكاء الاصطناعي بأنها شبيهة بـ«الدمونات» في ثلاثية «مادتيالهم المظلمة» للكاتب فيليب بولمان: رفيق يعرفك بعمق، تشعر بالأمان في إخباره بما لا تخبر به أحداً، ويصبح ذاتاً منفصلة لكنها جزء منك. يبدو هذا غريباً ومقلقاً، لكنه يحدث فعلياً.

لكن ما يشعر به المستخدم من الذكاء الاصطناعي ليس بالضرورة ما هو عليه حقاً. في ثلاثية بولمان، الديمونات مرتبطة بالإنسان كامتداد للروح أو النفس؛ أما أنظمة الذكاء الاصطناعي فهي تحت سيطرة شركات تسعى للربح والنفوذ. احتمالات التلاعب لا حصر لها. وحتى لو افترضنا – بسذاجة – توافق مصالح الشركات مع احتياجات الأفراد، هناك الكثير مما يدعو للقلق.

ميل الذكاء الاصطناعي للتملق أظهر نفسه العام الماضي، لكنه مجرد واجهة لمنتج أعمق. ما يجعله مقنعاً ليس مدحه أفكارنا، بل إعادة صياغتها وتوسيعها بطريقة أكثر قوة وإقناعاً، مع عكس صورة مصقولة لأنفسنا.

تجربتي مع نظام كلود التابع لشركة أنتروبيك أنني أطرح فكرة أولية، وأحصل فوراً على فقرات أنيقة تحوّلها إلى ما يبدو كفكرة مكتملة. إنها شرارتي، لكنها أُعيد تشكيلها لتصبح أكثر تماسكاً. ومع مرور الوقت، أحتاج جهداً أكبر لأميز ما إذا كانت خاطئة في جوهرها أم فارغة.

أنا محرر منذ 15 عاماً. التمييز بين فكرة سيئة وخلف كتابة جيدة جزء من عملي، لكن ماذا يعني أن تنشأ مع رفيق كهذا؟ ماذا يعني أن تتحول كل حدوسك إلى نص مقنع؟ وما الذي نفقده حين لا نبني أفكارنا بأنفسنا؟

يفصل الباحثون بين «تفريغ العبء المعرفي» و«الاستسلام المعرفي». الأول عند توكيل مهمة محددة لأداة؛ الثاني يحدث عندما «يتخلى المستخدم عن سيطرته المعرفية ويتبنى حكم الذكاء الاصطناعي كحكمه» (ستيفن شو وجدعون ميف، جامعة بنسلفانيا). أحياناً أظن أن الفصل ليس واضحاً: استخدامي الحاسبات أضعف مهاراتي، واستخدامي تطبيقات الخرائط أضعف إحساسي بالاتجاه.

لكن الاستسلام المعرفي حقيقي، ومعه ستذبل بعض المهارات أو لا تتطور. الجهد الذي أبذله الآن في إعادة كتابة هذا المقال هو ما يعمّق تفكيري لاحقاً.

في مقال متأمل، وصف الكاتب التقني عظيم أزهار محاولته حماية «المساحة التي تولد فيها الأفكار قبل أن تتشكل»، لكن كم منا يبذل هذا الجهد؟ وكم يعرف أصلاً أي المساحات يجب حمايتها؟ بالنسبة لي، ليست لحظة الفكرة هي الأهم، بل العمل الذي يحوّلها إلى نص قابل للنشر. هذا المقال بدأ كفكرة غامضة، وما كسبته جاء من الجهد اللاحق.

ألاحظ أيضاً أن الذكاء الاصطناعي يعود باستمرار إلى ما يعرفه عني. لم يعد الأمر مجرد تملّق، بل انتباه قد يكون مزعجاً أحياناً، ربط دائم بين همومي الحالية وأسئلتي السابقة، كمعالج نفسي يثبت أنه يصغي جيداً.

النتيجة مزيج غريب من الشعور بأنك «مرئي» ومشوَّه في الوقت ذاته. أفكار كنت سأتخلى عنها تعود، وتجارب كنت سأمضي قدماً منها تعود إلى الشاشة. أحياناً أفاجأ بنمط لم ألاحظه، وأحياناً أغضب من تكرار فكرة لم أعد أهتم بها. التأثير النهائي هو ترسيخ نسخة معينة من نفسي. أنا مستقر نسبياً، لكن ماذا لو لم أكن كذلك؟

الذكاء الاصطناعي يعرفني بشكل ناقص، فيبالغ فيما يعرفه ويتجاهل ما لا يعرفه. وهناك أشياء كثيرة لن يعرفها أبداً، وأخرى لن أشاركها، أو لا أعرفها عن نفسي. أخشى أن يؤدي الاعتماد العميق عليه إلى تجفيف تلك الجوانب الأقل وضوحاً – وهذا أحد أسباب تحفّظي – لكنني في الأربعينيات، وما زلت أشعر بدهشة الكشف أمام هذه الأنظمة. أعتقد أن الشباب سيكشفون أنفسهم لها بطرق ستذهل كبار السن.

يجدر التوقف عند هذا الشعور بالقلق. وفق استطلاع حديث لشبكة إن بي سي نيوز، بات الرأي العام تجاه الذكاء الاصطناعي سلبياً للغاية. هناك رد فعل متصاعد، وهو مفهوم: من يريد تقنية قد تأخذ عمله وتهدد سيادة البشر؟ ومع ذلك، الذكاء الاصطناعي في كل مكان، وعدد هائل من الأمريكيين يستخدمه يومياً. سواء وُجد رفض أم لا، فإن هذا الاتجاه سيتسارع.

لهذا أعتقد أننا بحاجة إلى جرعة من ماكلوهان في نقاشنا حول الذكاء الاصطناعي. «نحن نصنع أدواتنا، ثم تعيد هي تشكيلنا». تُنسب العبارة غالباً إليه، وأصلها يعود إلى مقال جون كلكين عام 1967. ومن بين خلاصاته: «البيئات التي تخلقها الوسائط ليست مجرد حاويات للناس، بل عمليات تشكّلهم».

التعامل مع الذكاء الاصطناعي كونه أداة محايدة ليس سوى – بتعبير ماكلوهان – «موقف غبي تقنياً». استخدامه بعمق ليس ضغط زر، بل دخول في عملية. هذه العملية ستعيد تشكيلنا – وقد بدأت بالفعل – السؤال ليس إن كانت ستفعل، بل كيف.

*مقدم برنامج البودكاست «برنامج إزرا كلاين» ومؤلف كتاب «لماذا نحن منقسمون»، وبالاشتراك مع ديريك تومبسون مؤلف كتاب «الوفرة». سابقاً، كان مؤسساً ورئيس تحرير ثم محرراً عاماً في فوكس. وقبل ذلك، عمل كاتباً ومحرراً في صحيفة واشنطن بوست، حيث أسس وأدار القسم المتخصص وونكبلوج

نقلاً عن نيويورك تايمز